La irrupción de la Inteligencia Artificial (IA) está moviendo los cimientos del esquema tradicional del trabajo. En este post, queremos saber qué significa una nueva tecnología como la IA para el futuro del trabajo y de las organizaciones.

Lo primero es separar el grano de la paja. La posibilidad de que las máquinas puedan pensar mejor que los humanos ha generado siempre mucha expectación. En 1950, Alan Turing inventó un experimento, llamado la Prueba de Turing, para poder medir ese avance.

Pero lo que ha desatado el ruido actual, generando fascinación y ansiedad a partes iguales, es el lanzamiento en noviembre de 2022 de ChatGPT 3.5 por parte de la empresa Open AI. Su gran avance es la capacidad de responder a preguntas a través de un Chat a partir de la vasta documentación con la que se le ha entrenado. Superaría con alta distinción el test de Turing, ya que sus respuestas son prácticamente indistinguibles de las de cualquier terrícola. Es más, en muchas ocasiones lo hace incluso mejor, motivo por el que se ha desatado tanta exageración. Y, porque hay un gran desconocimiento sobre qué hay realmente detrás de esta tecnología.

¿Cómo funciona la Inteligencia Artificial?

Para empezar, hay que aclarar que no hay un acuerdo general sobre qué es la Inteligencia Artificial. No hay una definición única. De hecho, el nombre no es el mejor de los posibles, como veremos más adelante. Simplemente, se denomina así porque solemos llamar «inteligencia» a todo aquello que es capaz de resolver un problema.

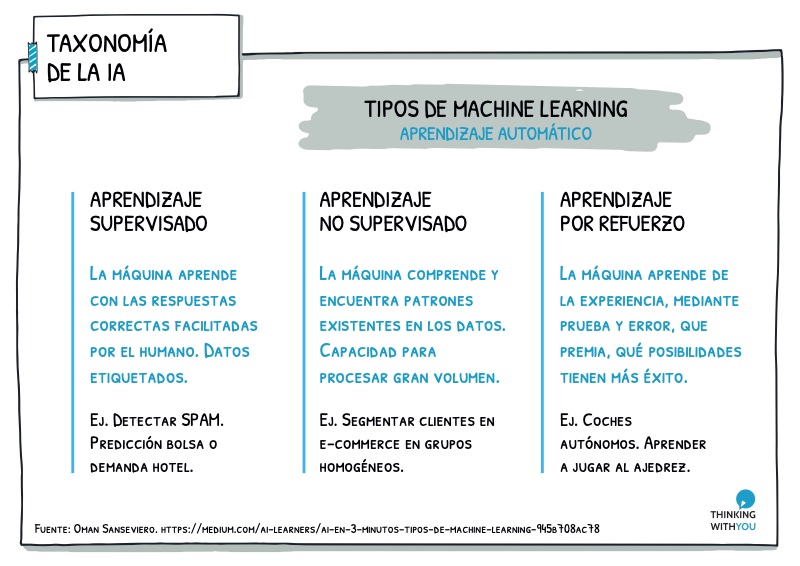

De hecho, hasta 2010, se llamaba Inteligencia Artificial al algoritmo que, mediante aprendizaje automático, analiza y predice datos. La Inteligencia aprende a partir de datos etiquetados por humanos y es capaz de predecir comportamientos. Por ejemplo, cómo van a fluctuar los mercados de valores o la demanda de una zona turística determinada.

En realidad, estamos ante lo que se llama «aprendizaje supervisado», que significa que la máquina necesita que las personas etiqueten previamente los datos sobre los que aprenden. En este caso, no hay demasiado inteligencia, ya que el modelo tiene dificultades para decidir con los datos no etiquetados.

El gran salto llega con la aparición en 2017 de una nueva técnica de «aprendizaje no supervisado» llamada Transformer, que no necesita datos etiquetados para hacer predicciones. Lo que hace diferencial a esta tecnología, sobre la que trabaja todo lo que ahora llamamos IA, es que sopesa las diferentes partes o frases en un bloque de texto y, a partir de ahí, es capaz de predecir qué token o palabra sigue a la anterior.

Se la considera una «Inteligencia Artificial Generativa» porque usa técnicas de aprendizaje no supervisado para aprender y generar nuevos datos. Funciona mejor cuánta mayor información (big data) haya utilizado en su entrenamiento previo. Aunque realmente es un predictor de siguientes palabras, lo hemos considerado inteligencia porque se ha entrenado con documentación elaborada por humanos y sus respuestas parecen realmente escritas por personas.

Lo que hace que Chat GPT despierte tanta fascinación es que ha resultado muy útil para usos no previstos para las inteligencias generativas, como escribir discursos, guiones o, incluso, música. Si, además, se entrena al modelo con imágenes, puede producir nuevas imágenes, gráficos o vídeos a partir de instrucciones en texto llamadas prompts.

Lo importante es no olvidar que estamos ante un simple «auto-completado de palabras». Y que no es realmente inteligente porque, a veces, proporciona respuestas aleatorias, que no se corresponden con la realidad. Sí, se inventa cosas, un fenómenos al que los expertos se refieren como «alucinaciones».

Para minimizar la cantidad de alucinaciones, ChatGPT, al igual que el resto de IAs, necesita de la «retroalimentación humana», es decir, de personas que le premien cuando da respuestas verídicas, y le reprenda cuando son falsas. Por tanto, el modelo se complementa con un «aprendizaje por refuerzo». En el caso de las grandes tecnológicas, se hace a gran escala y estamos ante un LLM, o modelo de lenguaje de gran tamaño. Cuando la escala es muy reducida hablamos de Small Language Models.

Críticas a la IA

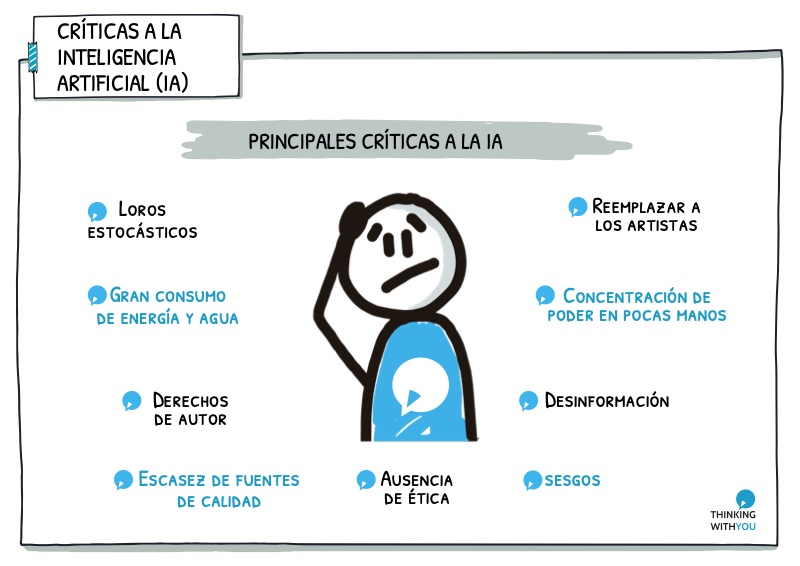

Una vez conocidos los fundamentos técnicos, es momento de abordar el gran lado oscuro de esta nueva revolución tecnológica.

Los más críticos aseguran que no hay tal Inteligencia Artificial. Que, en realidad, estos sistemas de predicción de palabras son «loros estocásticos», porque, como los pericos, dicen cosas pero no entienden su significado.

Los riegos de la IA son varios:

# Gran consumo energético. Para enseñar a los poderosos LLM, se requiere de grandes y potentes ordenadores, que consumen una gran cantidad de energía para funcionar y de agua para refrigerarse, con su impacto en el medio ambiente.

# Concentración de poder en pocas manos. Derivado de lo anterior, el alto precio para construir los mega centros de datos hace que las IA se concentren en pocas manos, con los consiguientes riesgos de toda alta concentración de poder.

# Derechos de autor. Otro factor que se suele pasar por alto es que los grandes modelos de lenguaje se entrenan con grandes cantidades de fuentes documentales y que pocas veces se pide permiso a sus autores. La industria no ha revelado todavía las fuentes con las que ha preentrenado a sus modelos, pero, por los resultados, hay más que evidencias que han tomado como referencia libros, artículos y textos de Internet, muchos de los cuales están protegidos por derechos de autor. Las empresas se amparan en que las IA no plagian sino que «homenajean» al original, cuyos datos toman para crear una obra completamente nueva. Como la frontera no está clara, podemos colegir que estamos ante un problema legal a resolver en los próximos años.

# Escasez de fuentes de calidad. Relacionado con lo anterior, hay un problema añadido con entrenar a los modelos con datos futuros. Ya han sido entrenadas con lo que podríamos considera fuentes buenas y gratuitas. La Web, a tenor de los resultados de búsqueda de Google, está llenando de contenido generado por IAs, reduciendo a la larga la calidad. Los humanos, y sus buenos comentarios, se han mudado a comunidades o foros, como Reddit. Las grandes tecnológicas quieren que sus LLM tengan acceso a estos comentarios mientras que sus autores reclaman su parte del botín.

Ya han entrenado con las fuentes buenas y gratuitas. Google se ha llenado de contenido generado por IAs, lo que va reduciendo la calidad. Los humanos se refugian en foros como a los que quieren acceder las empresas de IA.

# Sesgos. Otro problema de la falta de realidad de las respuestas son sus enormes sesgos, tanto de raza como de género. Al estar creadas, en su mayoría, por hombres, de raza blanca y altos conocimientos informativos, los modelos están reproduciendo los prejuicios de este segmento de población. Por ejemplo, Amazon utilizó Inteligencia Artificial para sus contrataciones, pero al ser la mayoría de gerentes hombres, les ponderaba en los reclutamientos. Ciertamente, las IA reproducen el contexto de donde toman los datos para aprender. Famoso es el caso de Tay, un bot creado por Microsoft para responder en Twitter a partir de los mensajes que le llegaban. No tardaron muchas horas para que lanzaran soflamas del tipo «Hitler tenía razón». Tan sólo duró 16 horas abierto. Il Sung Park lo resume con la frase «si entra basura, sale basura». Para evitarlo, se precisa que los modelos de lenguaje se entrenen con datos balanceados y que reflejen la diversidad.

# Desinformación. Igualmente, las IA facilitan la creación de noticias falsas, como la imagen del Papa Francisco con un anorak de la lujosa marca Balenciaga, que nos creímos.

# Reemplazar a los artistas. Los algoritmos con tecnología Transformer tienen la posibilidad de crear obras nuevas a partir de las que aprenden. Los artistas están temerosos ante la posibilidad de que sean reemplazados por la IA a la que entrenaron. Como veremos en breve, esto no es realmente así, ya que la IA crean obras, pero todas muy parecidas, lo que difumina el concepto de exclusividad consustancial al arte.

# Ausencia de ética: Finalmente, está la madre de todos los riesgos. Aunque las IA tienen la instrucción de no dar respuestas que puedan perjudicar el bien común, y al conjunto de las personas, es fácil sortear estas instrucciones. Por ejemplo, nos puede dar consejos sobre actividades delictivas. En este gran debate, hay opiniones muy encontradas, con críticos apocalípticos, con Eliezer Yudkowsky o Nick Bostrom a la cabeza, y tecno entusiastas, como Sam Altman, el CEO de OpenAI, que cree que resolverá los problemas de la humanidad. En un punto, el profesor Ethan Mollick asegura que «no hay claridad absoluta sobre lo que hace la Inteligencia Artificial. No se sabe si es capaz de acertar exámenes difíciles porque es muy inteligente o porque esos datos formaron parte de su entrenamiento». El tiempo dirá.

En definitiva, estamos ante una tecnología que levanta grandes preocupaciones y objeciones ética. Cumplir con que la IA se utiliza con fines útiles y no perjudiciales, o nefastos, es lo que los técnicos están denominando «alineación». Nuestro reto es que asegurarnos que sirve a los intereses humanos y no los daña. Algunos grupos sociales ya están organizando para tan noble propósito.

Necesitamos normas y estándares acordados para el desarrollo y el uso ético de la IA, moldeados a través de un proceso inclusivo que represente voces diversas. Ethan Molick. Co-Inteligence.

La IA y el futuro del trabajo

Algunos autores hablan de «la Era de la IA» porque esta ola tecnológica presenta características inéditas, empezando por su rápida adopción. ChatGPT tardó cinco días en alcanzar el millón de usuarios. A Twitter le llevó dos años y a Instagram, tres meses.

Mientras el resto de revoluciones automatizaban el trabajo repetitivo y mecánico, los LLM son muy buenos en tareas propias de los trabajadores mejor educados, remunerados y más creativos, como traducir, codificar, escribir, analizar, hacer presentaciones o agrupar información.

Muchas de las cosas que hacemos hasta ahora se harán de forma distinta. Por lo pronto, la situación que más se repite en las organizaciones es la añadir una funcionalidad de Inteligencia Artificial en sus productos o servicios estrella. Así «cubren la posición», como se llama en el argot automovilístico el evitar ser adelantado por un competidor al entrar a repostar.

La prosperidad o supervivencia de un profesional o empresa dependerá enormemente de su habilidad para integrar estas nuevas tecnologías en la labor diaria. Il Sung Park

¿Cómo funcionamos con la IA?

El reto actual es cómo actuar con una tecnología que puede emular nuestra forma de pensar y escribir.

En su muy recomendable libro Co-Inteligence, el profesor Ethan Mollick propone cuatro principios generales para convivir con la Inteligencia Artificial:

# Invita siempre a la Ia a tu mesa. Según Mollick, «familiarizarse con las capacidades de la IA permite comprender mejor cómo puede ayudarlo o amenazarlo y a su trabajo». Este autor defiende que, pese al «Tsunami de la IA», que nos trae soluciones mágicas cada semana, no es, a día de hoy, una solución milagrosa. Incluso, no sabemos todavía el potencial real y las limitaciones de la tecnología. En algunas cosas, como generar ideas, es mejor que los humanos, por su capacidad para «alucinar». Esta misma aleatoriedad innata hace que otros resultados sean desastrosos. Lo mejor es experimentarlo en nuestra actividad habitual, hasta lograr, con prueba y error, el mejor rendimiento posible. Como hacer esto a las empresas les puede resultar costoso, pero no individualmente, Mollick recomienda que se incentive su uso en las organizaciones, para compartir los aprendizajes de las personas más avanzadas, según la Curva de Rogers, ya que usarán los LLM, aunque se prohiban.

# Sea el humano que está al tanto. Recordemos que «la IA no sabe nada, tan sólo es capaz de predecir la siguiente palabra en una secuencia». Como no son capaces de distinguir la verdad de la mentira, los mejores resultados se consiguen conjuntamente con los humanos. Es cierto que hacer algunas tareas con una IA puede ser hasta un 37% más rápido que hacerlo con medios tradicionales. Pero, también lo es que los resultados serán muy parecidos y, a la larga, mediocres. Para exprimir todo el jugo, es preciso ordenar cambios al modelo hasta lograr lo que realmente queremos. Mollick dice que las personas con mejores conocimientos previos sobre una materia, como el arte, son quienes tienen más posibilidades de lograr resultados finales más asombrosos. Sólo necesitan saber qué pedir. De hecho, en el libro Inteligencia Artificial Aplicada Hoy, que expone múltiples casos de uso en diferentes sectores, se concluye que, junto a los puestos de trabajo suprimidos, se están creando muchos otros para ser el humano que verifica y detecta las mentiras y alucinaciones.

# Trate a la IA como una persona. Aunque ya sabemos que es sólo un algoritmo, éste ofrece sus mejores resultados cuando le atribuimos una personalidad clara, definimos quién es la IA y qué problema debe resolver. Mis favoritos son pedir que escriba como Cervantes o con la ironía de Groucho Marx. Después, ofrecerle un contexto y limitaciones. Finalmente, brindar alguna orientación sobre cómo generar resultados que coincidan con tus expectativas y necesidades. Siguiendo esta secuencia, tendremos los mejores resultados.

# Asume que es la peor IA que usarás nunca. El desarrollo de los modelos de Inteligencia Artificial es tan veloz que, cualquier herramienta que usemos hoy, quedará desfasada en pocos meses. No te enamores de ninguna herramienta.

¿Cómo afectará a los trabajos?

Hay un relato apocalíptico que preconiza que la IA nos dejará sin trabajo: un estudio concluye que sólo 36 categorías laborales de 1.016 no se superponen con la Inteligencia Artificial. Son las que desempeñan algún tipo de actividad física.

Superponerse no se traduce en reemplazar. Esto nos obliga a repensar y cambiar cómo trabajamos en la actualidad. En el sector educativo, que está tomando la delantera por la fascinación que genera entre los más jóvenes para que les haga los deberes, ya se da la paradoja que se entregan trabajos creados con Inteligencia Artificial y los profesores los corrigen con la misma tecnología de aprendizaje automático. Lo mismo ocurrirá en las empresas con los informes que se encargan para no ser leídos, o correos redactados por bots que contestará otro bot.

La IA es el «apocalipsis» de todo este trabajo inútil, absurdo y burocrático que genera tanta entropía en las organizaciones. Es una herramienta que nos puede hacer más productivos, sí, pero para ello hay que actualizar la gestión de la organización, reduciendo costes y optimizando procesos.

Empieza a adaptarte a la IA

El profesor Ethan Mollick narra un experimento cuyas conclusiones nos revelan cómo será la IA y el futuro del trabajo. Encargaron a un grupo de consultores realizar 18 tareas a la manera tradicional y a otro grupo usando un LLM. El grupo que trabajó con la IA obtuvo mejores resultados e hicieron el encargo más rápido. Aunque, la mayoría sólo hizo un copia y pega.

Luego, les encargaron un problema que el algoritmo por sí solo no resolvía. El grupo que trabajaba como siempre triunfó aquí porque la alternativa se contentó con las respuestas del LLM.

El juego descubrió que la IA nos vuelve «perezosos, descuidados y menos hábiles al propio juicio». Depender sólo de ella es contraproducente porque nos resta a los humanos motivos para trabajar duro.

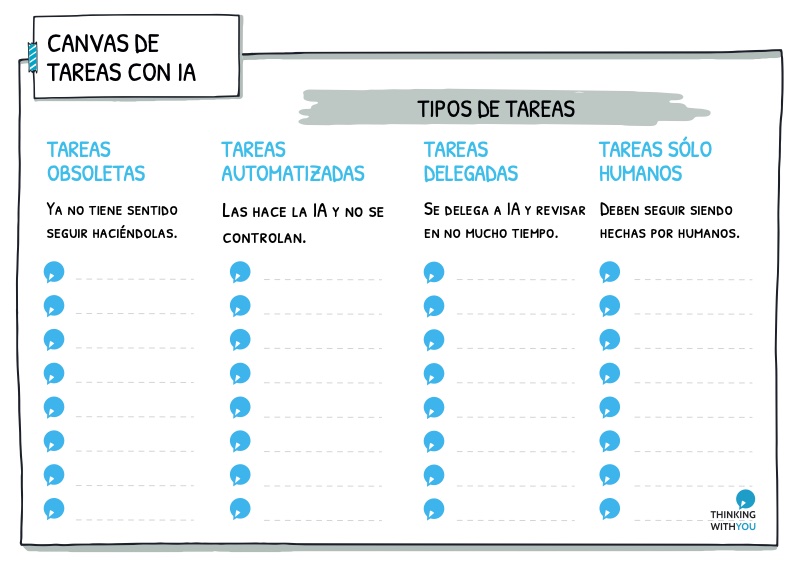

Ahora, te proponemos un sencillo ejercicio para comenzar a cambiar nuestra interacción humana con la IA. En un canvas con cuatro columnas, escribe a la derecha las tareas que tiene sentido que siga haciendo como persona humana porque son significativas o le dan satisfacción. Por ejemplo, dar feedback a una persona del trabajo que se lo solicita para su crecimiento personal.

En la segunda columna, de derecha a izquierda, ponga las tareas que puede hacer un LLM y necesitan una revisión superficial porque no tienen importancia o requieren mucho tiempo. Por ejemplo, crear el acta o bitácora de una reunión.

En la tercera columna, las tareas que sólo realizará una IA y no se controlarán. Por ejemplo, hacer un gráfico con el número de visitas a las redes sociales. Finalmente, apunte tareas que ya no tiene sentido seguir haciendo en la Era de la IA. Por ejemplo, hacer exámenes del tipo escribir una redacción. A continuación, tiene una plantilla para completarlo.

Esta distribución estratégica por tareas puede revisarse periódicamente. El consejo de Ethan Mollick es investigar los mejores usos y fomentar el uso de las IA en las organizaciones, para aprovecharse de los usos innovadores de las personas más adelantadas con el uso de las LLM. El mejor uso llega mediante una co-inteligencia, con la interacción de personas y máquinas.

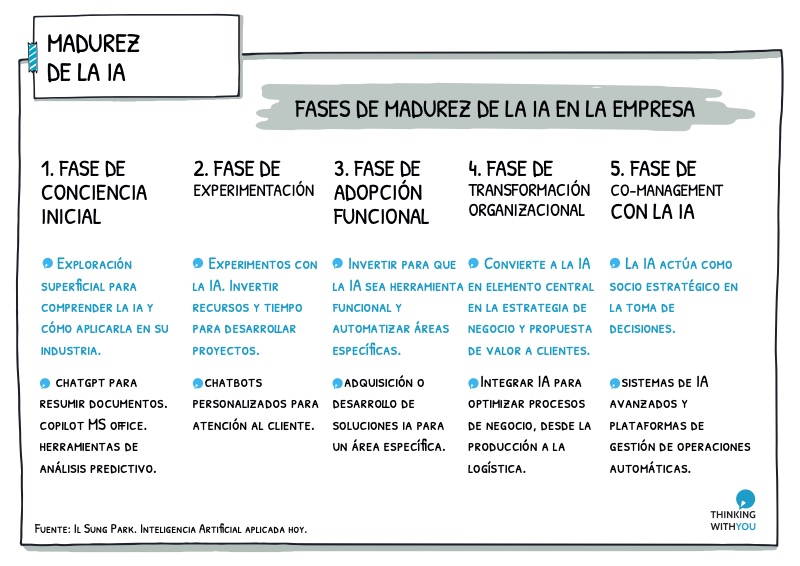

Il Sung Park nos propone una gradación en cinco fases, según la madurez en la adopción de la Inteligencia Artificial en una organización.

En Thinking with you ya hemos ayudado a algunas organizaciones con casos de utilización de la Inteligencia Artificial.

¿Hacia donde vamos?

El tecnólogo británico Azeem Azhar habla de los tres niveles de trabajo con una nueva tecnología de propósito general, como es la Inteligencia Artificial:

# Nivel 1. Hacer lo que hacemos nosotros a un precio más económico. En estos momentos, asistimos al boom de los LLM, como ChatGPT, Copilot, Lama o Gemini. Aquí la principal restricción llega por el precio de uso, que impide que no todas las personas los puedan utilizar. Se trata de un primer paso obvio: supervitaminar con IA todas las innovaciones disruptivas de la década pasada.

# Nivel 2: Hacer lo que hacemos nosotros, pero hacerlo mejor. Un paso próximo en el que ya trabaja la industria es en hacer hablar ChatGPTs entre sí. A esto lo llaman «agentes generativos». El objetivo es que cada ChatGPT tenga la personalidad y especialidad de una persona concreta para convertirse en su «gemelo digital». Así, podremos mandar a este bot a reuniones en la que nos sustituirá. Ya se puede experimentar con herramientas como CrewAI o Dialogflow CX especializadas en Digital Twins.

# Nivel 3: Hacer cosas completamente nuevas. El tercer paso es el de la co-inteligencia entre personas y máquinas, para lograr una «inteligencia colectiva aumentada» o Superminds. Un ejemplo de este escenario de coexistencia lo vimos en la película IA de Steven Spielberg.

Azhar concluye que «la mayoría de las empresas están estancadas en el nivel 1 o el nivel 2. Están usando IA para reducir costos o mejorar procesos de manera incremental, perdiendo la oportunidad de repensar estratégicamente cómo podría ser su negocio y cómo abordar el replanteamiento en sí».

Al igual que la Era de Internet trajo sus formas propias de trabajar (Agile, Lean) y de organizarse (equipos autogestionados y sociocracia), podemos pronosticar que la Era de la Inteligencia Artificial tendrá las suyas. Aquí, la Ciencia Ficción ha traído muchos ejemplos de sometimiento de los humanos a una gran AGI (Inteligencia Artificial General) capaz de ordenar y saberlo todo, con una capacidad mucho más avanzada que la de las personas. Aunque no se deje llevar por visiones distópicas. Conviene recordar que las personas tenemos una «agencia» para actuar y decidir nuestro propio destino y el de nuestras organizaciones.

Desde Thinking with you os podemos ayudar a gestionar el cambio y explicaros cómo lo estamos viviendo nosotros internamente.

Thinking With You

Acompañamos a personas, equipos y organizaciones en la comprensión y adaptación al contexto de cambio que vivimos.